- 会員限定

- 2017/07/03 掲載

ディープラーニングで花特定、100キロ可搬の二足ロボ--千葉工大の何がスゴいのか?

ディープラーニングで花の名前や種類を分類表示

東京スカイツリータウン・ソラマチ8階にある千葉工大 東京スカイツリータウンキャンパスには、同校の研究・開発によって誕生した数多くのロボットから、人工知能技術や、惑星探査による宇宙技術まで、最先端の展示物が一堂に紹介されている。まず大きな目玉展示として注目を浴びていたのが、人工知能・ソフトウェア技術研究センターが監修した「hananona(ハナノナ)」だ。これは約30万枚もの花の写真をディープラーニングによって学習させ、406種類の花のうち最も近いと思われる花の名前や種類を教えてくれる花分類システムだ。

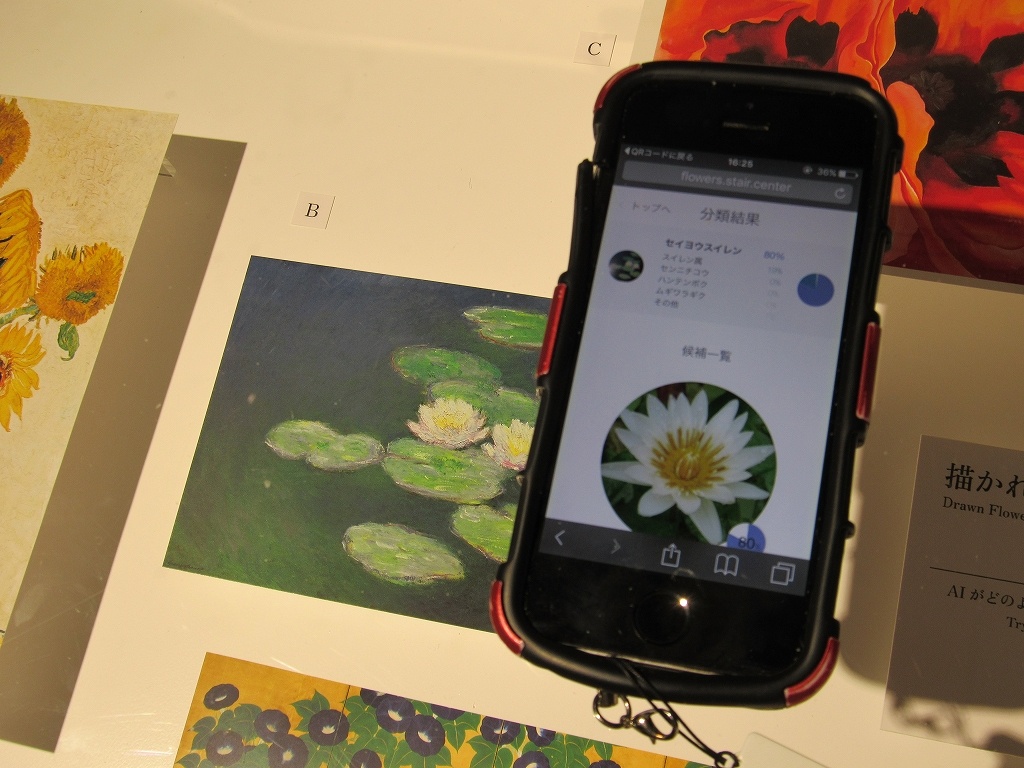

調べたい花の写真や絵など、抽象度の異なる素材を中央テーブルに置くと、上部に設置されたカメラから対象物が撮影される。そのデータがネットワーク経由でクラウド側のサーバに送られ、自動判定した結果をシステム側に返してくれる。

分類結果は「花マップ」と呼ばれる、クラスター化された花分類のなかで表示される。対象が具体的にどこに位置しているのか、万華鏡のような美しい4Kの円形ディスプレイによって視覚化される。406種類以外の訓練していない花の場合は、正解の名前まではないものの、形の似ている花に分類してくれるという。

また、hananonaはWebバージョンも開発されており、スマートフォンなどからも利用できるようになっているため、花が好きな方は試してみるとよいだろう。

千葉工業大学 人工知能・ソフトウェア技術研究センター 主席研究員/工学博士 竹内彰一氏は、「花の分類に着目したのは、花は形が似たようなものが多く、見分けがつきづらいからです。たとえば人と猫というように明らかに異なるものであれば、誰でも簡単に区別できます。似ているものをいかにキメ細かく分類していくかという点がチャレンジのポイントでした」と語る。

hananonaの画像認識は22層のCNNで判定

人工知能・ソフトウェア技術研究センター

主席研究員/工学博士

竹内 彰一 氏

「開発に着手したのは1年半ほど前のことですが、やはり必要なデータを揃えるのに苦労しました。今回は花を対象にしていますが、応用として鳥や昆虫、木の葉などの認識させれば、インタラクティブ図鑑のようなものもつくれるようになるでしょう」(竹内氏)

ビジネス的な応用としては、たとえば医療分野において、レントゲンや内視鏡などで撮影した写真を判別することにも使える。画像認識に関わるビジネスであれば、いろいろなことに応用が利くが、今後は認識モデルを変えて、音声・音響にも適用したい意向だ。機械などの音響を調べ、ネジのゆるみやベアリングの劣化など、事前に故障しそうな部分を調べることも可能だ。

「いま人の基本的な動作を集めて、それを認識できる技術を開発しようとしているところです。我々には、ロボットの研究所(未来ロボット技術研究センター)もあるため、ロボットへの応用もブレストしているところです。まだ発表段階の具体的な成果はありませんが、各研究所で刺激しあいながら開発を進めていきたいと考えています」(竹内氏)。

【次ページ】可搬重量100㎏の二足歩行ロボットやロボット解剖学も新たに展示

関連コンテンツ

PR

PR

PR