- 会員限定

- 2024/11/21 掲載

恐怖のAI兵器「LAWS(自律型致死兵器システム)」とは?使用規制が進まない複雑な事情

合同会社Noteip代表。ライター。米国の大学でコンピューターサイエンスを専攻し、卒業後は国内の一部上場企業でIT関連製品の企画・マーケティングなどに従事。退職後はライターとして書籍や記事の執筆、WEBコンテンツの制作に関わっている。人工知能の他に科学・IT・軍事・医療関連のトピックを扱っており、研究機関・大学における研究支援活動も行っている。著書『近未来のコア・テクノロジー(翔泳社)』『図解これだけは知っておきたいAIビジネス入門(成美堂)』、執筆協力『マンガでわかる人工知能(池田書店)』など。

LAWSとは? 機械自らの判断で人を攻撃する兵器

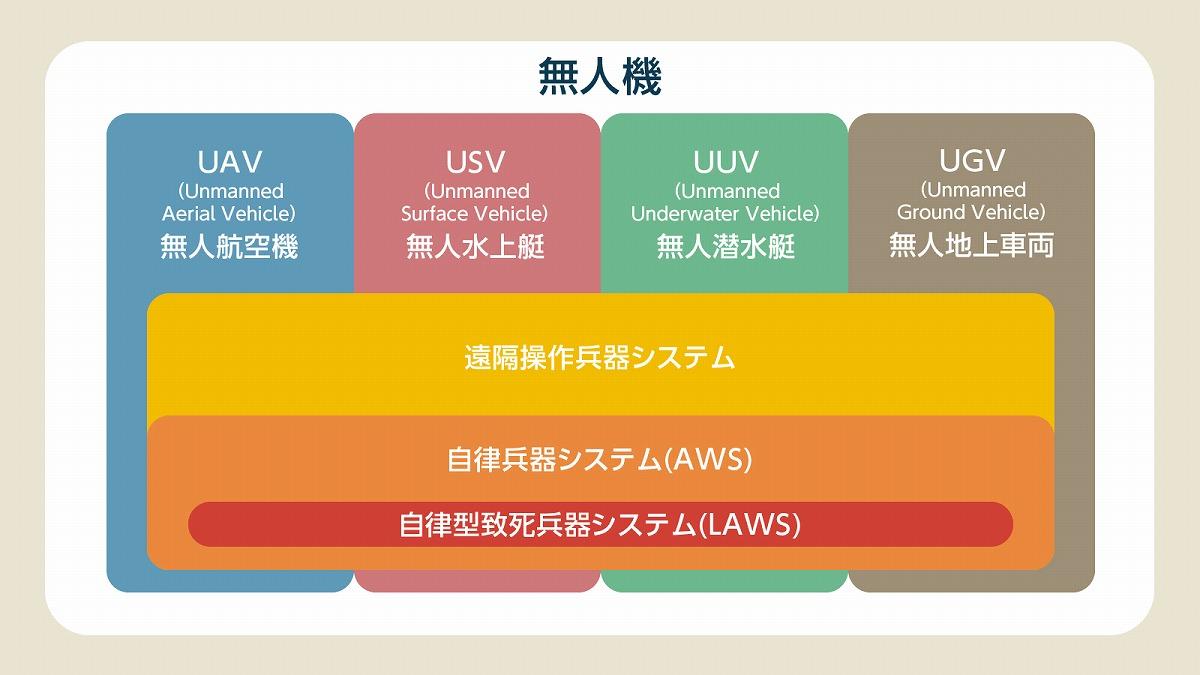

LAWS(ローズ)とは、「Lethal Autonomous Weapon Systems」の略称で、日本語では「自律型致死兵器システム」と呼ばれており、人間による遠隔操作を必要とせず、機械自らの判断で人を殺傷する能力を持つ兵器のことを指します。無差別に人を殺傷する可能性があることから、非人道的な兵器と考える国も多く、国際的な規制について検討が進められています。類似の用語として、致死性があるかどうかを問わない自律兵器システムである「AWS(Autonomous Weapon Systems)」があるほか、自律性を問わない兵器として「無人機」という用語があります。また、無人機の中ではさらに「UAV(無人航空機)」「USV(無人水上艇)」「UUV(無人潜水艇)」「UGV(無人地上車両)」のように、どこで使われるかによって呼び方が分かれます。

つまり、無人機の中にUAVなどの種別があり、その中で「遠隔操作型」と「自律型」に分かれ、自律型の中に「致死性」か「非致死性」かの区分があるというわけです。

2024年時点の戦場で広く使われている無人兵器の多くが遠隔操作型で、無人機に搭載されているカメラを使って状況を確認しながら操作をする「FPV(一人称)型」が主流です。この場合、人間が攻撃の判断をしているため、致死性かどうかは問われません。

また、ミサイルのように人間が攻撃指示を与えた後に自律的に飛翔して人を殺傷する誘導兵器も自律型という扱いにはならず、自動化された攻撃兵器として認められています。

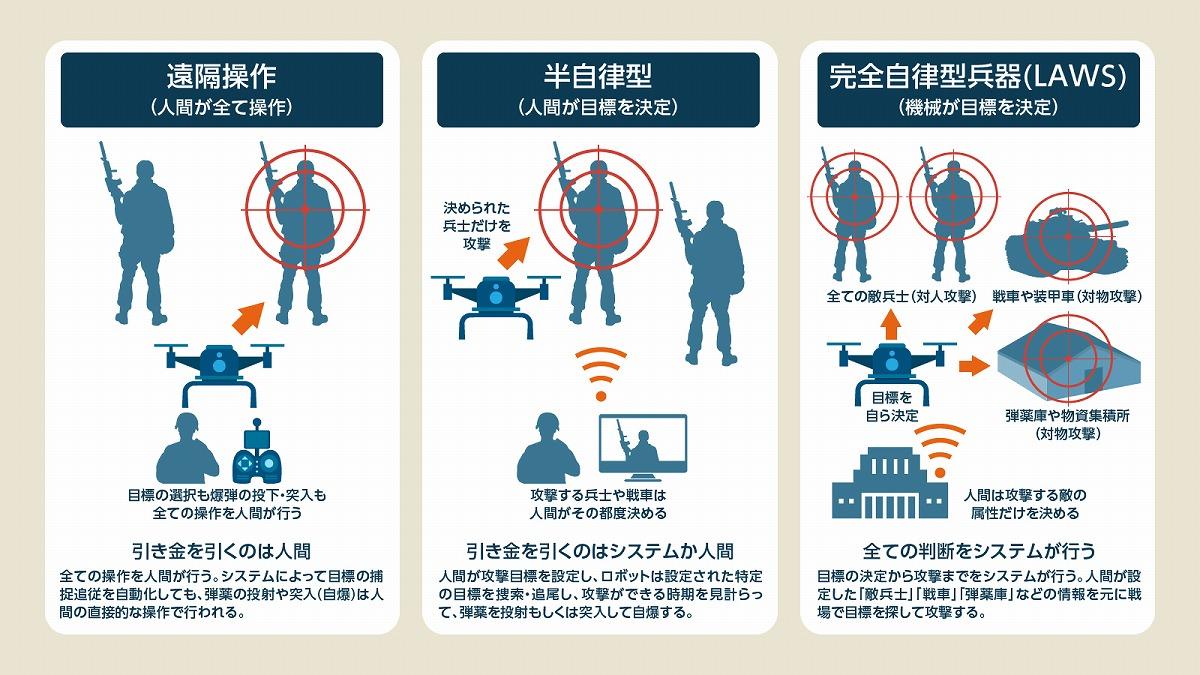

「遠隔操作型」「半自律型」「自律型」の違い

では、どのような兵器が自律型の殺傷兵器であるLAWSという分類になるのでしょうか。国際法における定義については議論が進められている段階ですが、基本的には「攻撃目標の選定」から「攻撃の実行」までのプロセスに、人間がまったく介入せずに動作することができる兵器についてはLAWSであると考えられています。

しかし、このミサイルが空中をゆっくりと巡回していて、近づいてきた航空機を自律的に捕捉して接近し、爆発して撃墜するような設計になっている場合はどうでしょうか。目標の選定から攻撃の実行までが自律化されており、LAWSに分類される可能性が高いです。

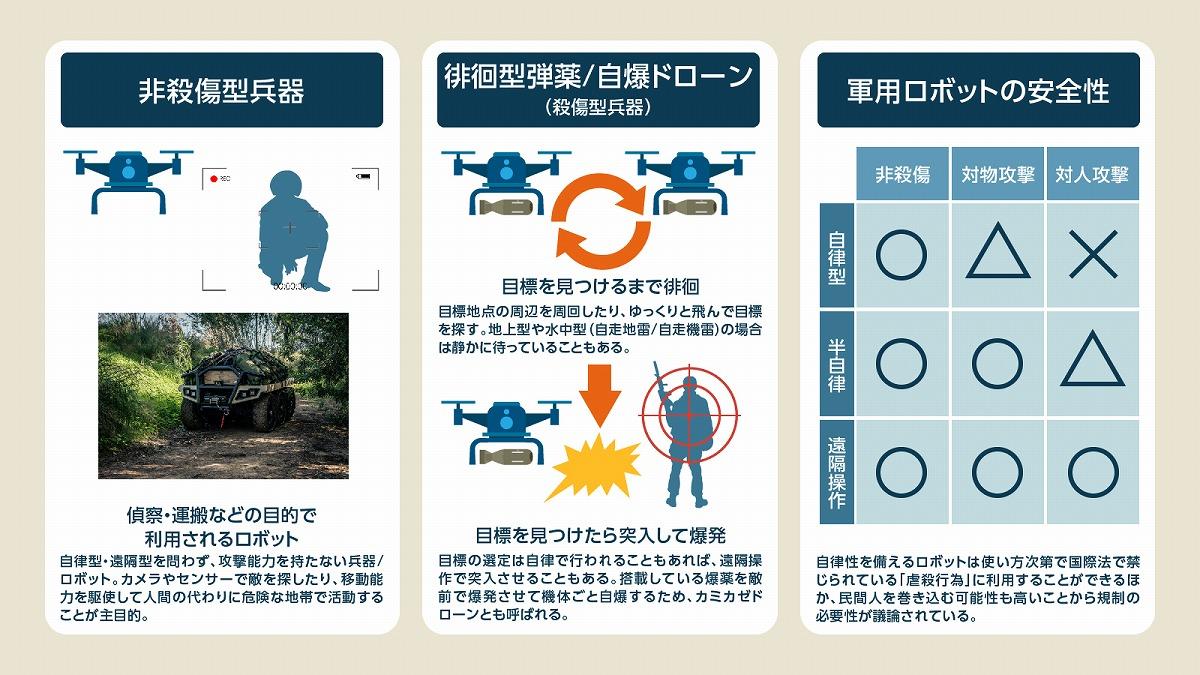

このような目標が定まっていない段階で目標付近まで近づき、攻撃できる目標を見つけてから攻撃行動に入る兵器を自律的かどうかを問わず「徘徊型弾薬」や「自爆ドローン」と呼びます。

2024年の時点で使われている自爆兵器のほとんどが遠隔操作型で、自律性があったとしても目標の選定自体は人間がやっているため基本的にはLAWSには分類されません。しかし、画像認識で戦車などの兵器を識別し、自律的に目標を定めて攻撃することは技術的には十分可能となっています。

ウクライナ戦争下の攻撃作戦はどれに分類される?

そのため、倫理的に問題のない殺傷能力を持たない自律兵器は広く使われるようになっています。たとえば、偵察用ドローン(UAV)などがよく知られており、車両や人間を見つけたら自律的に撮影や追跡を行い、詳細な情報を基地に送ります。それだけであれば倫理的な課題はありません。問題は「敵がいる」と判明した場所に自爆ドローンを送り込むケースです。戦車などの軍用車両を発見したものの逃げられてしまい、自爆ドローンで追跡して目標を見つけたら即座に攻撃するというのはウクライナ戦争などではよく行われている作戦です。こうした自爆ドローンは基本的には遠隔操作によって作戦を行いますが、仮に発見した車両の形状をドローンに覚えさせて自律攻撃させたとしたら、それはLAWSに当たるのでしょうか。

これは半自律型とも言える兵器システムで、目標の設定は人間が行っていますが、正確な位置は特定できておらず、人間からの指示は「この戦車を見つけ次第、攻撃しろ」というものです。自爆ドローンは自律的に索敵を行い、該当する戦車を見つけたら突入して自爆するでしょう。

これは議論の余地のある難しいテーマで、車両や建物のような識別が容易な目標については自律攻撃を許容できると考える国もあれば、人間を殺傷するリスクがある時点で許容できないと考える国もあります。

さらに、自律性は低いもののこれに類似する兵器はすでに存在しており、レーダー波を発している施設に向かって突入する「対レーダーミサイル」や海上で使用する「対艦誘導ミサイル」「自走機雷」は人間が目標を指定せず、機械が現場で標的を探します。

こうした兵器は漠然と攻撃するエリアを人間が指定して発射もしくは設置する形で使用され、戦場に到着してから目標を探して自らの判断で突入します。徘徊型兵器との違いは、戦場を長時間飛び回る徘徊性と対象を識別するセンサー技術が異なるだけで用途は比較的似ています。

ドローンとミサイルでは兵器の特性が異なるものの、車両・船舶・航空機など、敵味方の識別が比較的容易な目標であれば、機械の判断で攻撃しても良いのでしょうか。簡単に答えが出せるものではないのかもしれません。

使う側の目的は? LAWSの使用をめぐる論点

倫理的な課題のあるLAWSがなぜそこまで必要とされるのでしょうか。使う側の視点に立ち、兵器の特徴を整理していくと、下記のようなポイントに整理できます。<使用する理由>

- 危険な前線に人間の兵士を送る必要がない

- 前線に長時間にわたって展開しておくことができる

- 遠隔操作とは異なりジャミングの影響が少ない

- 迅速な判断と展開、低コストでの運用

<使用に伴う問題点>前線に人間を送る必要がなく、昼夜を問わず展開が可能で、遠隔操作型に多かったジャミング(レーダーや通信のための電波を、電波によって妨害すること)による妨害も抑えられる特徴があります。また、前線に人間を送る必要がなく、安全の確保などの準備期間が不要で、迅速に自律兵器の部隊を展開することができてしまいます。使い捨てが前提の兵器となるため品質も求められず、コストも抑えることができます。これらがLAWSが求められる理由になっていると考えらえます。

- 道義的責任などの倫理的課題

- 目標の誤認識などの技術的な課題

- サイバー攻撃を受けた場合の不確実性

- 人的被害が減ることによる紛争拡大の懸念

一方、人間の命を奪う判断を機械に任せて良いのかといった倫理的な問題があり、さまざまな妨害作戦が展開される戦場で目標識別の精度が維持できるのかといった技術的懸念もあります。

加えて、サイバー攻撃を受けてハッキングされた場合に兵器が悪用される懸念や不具合が発生した際にどのような被害がでるか予測できないといった問題も無視できません。

また、LAWSの使用により、戦争による人的被害やコストが抑えられ、戦争を起こしやすくなるといった懸念もあります。

2024年時点で、国際人道法では無差別に殺傷する兵器全般を禁止しており、LAWSも無差別に攻撃をするリスクがある場合はこれに抵触します。ただ、技術的に目標を指定できる場合には該当せず、LAWSを合法的に使用することは可能となっているため、LAWSを規制するための国際法については2024年の現在、検討が進められている最中です。 【次ページ】実際どんなAI兵器がある…? LAWSになり得る自律兵器の事例

航空・宇宙・軍事ビジネスのおすすめコンテンツ

航空・宇宙・軍事ビジネスの関連コンテンツ

PR

PR

PR